Eine gute statistische Analyse beinhaltet mehr als die korrekte Wahl und Anwendung von Methoden. Sie ist ein komplexer Prozess, der durchweg Stolpersteine in sich birgt. Diese beginnen beim Forschungsdesign Deines Fragebogens, gehen weiter zum Stichprobenziehen und erfordern oftmals auch eine grafische Darstellung in SPSS. Der folgende Beitrag beschreibt Grundlagen, die Du kennen solltest, noch bevor Du den ersten Mittelwert berechnest.

Statistische Analyse: Daten als Grundlage

Um statistische Tests durchzuführen und daraus belastbare Daten zu generieren, brauchst du gute Daten. Die schönsten Ergebnisse werden nutzlos, wenn sie aufgrund mangelhafter Datenqualität nicht aussagekräftig sind. Dazu gehört auch ein in sich schlüssiger, vollständiger und aktueller Datensatz. Deshalb ist es wichtig darauf zu achten, dass Deine Daten dazu geeignet sind, Deine Fragestellung zu beantworten. Das bedeutet, sie müssen alle relevanten Variablen mit der korrekten Genauigkeit abfragen. Ein Beispiel: Du interessierst Dich für die Körpergröße von Jugendlichen zwischen 13 und 17 Jahren. Hier nutzt es nichts, diese gar nicht, für Erwachsene oder auf volle Meter gerundet zu erheben. Doch auch bei der Messung selbst lauern Fallstricke. Um diese Tücken besser aufspüren zu können, empfiehlt sich der Statistik Service.

Statistische Analyse Gütekriterien: Objektivität, Reliabilität und Validität

Die sogenannten Gütekriterien sollen sicherstellen, dass Deine Ergebnisse reproduzierbar, inhaltlich korrekt und auf die Grundgesamtheit anwendbar sind.

Das schwächste Gütekriterium ist hierbei die Objektivität. Diese liegt vor, wenn Messergebnisse unabhängig von demjenigen, der die Messung durchführt, reproduziert werden können (vgl. Diekmann 2007). Für unser Beispiel bedeutet das, es muss völlig egal sein, wer das Maßband bei den Jugendlichen aus Deiner Studie anlegt. Hier mag das trivial erscheinen, aber denke zum Beispiel an persönliche Interviews. Für das statistische Verfahren bedeutet Objektivität, dass der Interviewer keinen Einfluss auf die von den Probanden gegebenen Antworten haben darf.

Einen Schritt weiter geht die Reliabilität, die sich auf das Messinstrument selbst konzentriert. Auch hier ist das Ziel die Reproduzierbarkeit. In unserem Beispiel müssen zwei Maßbänder dieselbe Körpergröße messen. Das ist für physikalische Größen relativ einfach, für abstrakte Konzepte wie „Glück“ gestaltet es sich schon schwieriger. Hier werden oft sogenannte Reliabilitätsanalysen durchgeführt, die die innere Konsistenz eines Messinstruments prüfen.

Validität: Es geht um das Wesentliche

Am Ende steht noch die Validität. Diese ist das logischste, aber auch komplexeste Gütekriterium. Stell Dir vor, Du möchtest die Körpergröße der Jugendlichen messen und stellst sie dafür auf eine Waage. Gut geeichte Waagen zeigen dasselbe Gewicht an und verschiedene Interviewer lesen es ab. Damit sind Objektivität und Reliabilität erfüllt. Das Problem: Eigentlich wolltest Du ja die Größe und nicht das Gewicht wissen. Bei der Validität geht es also darum, das zu messen, was Du auch messen möchtest – dies gilt auch für Online-Umfragen. Das kann, besonders bei abstrakten Merkmalen, schonmal schwierig werden.

Die externe Validität geht sogar noch einen Schritt weiter: Eine Messung ist nur dann extern valide, wenn sie auf die Grundgesamtheit erweitert werden kann. Medizinische Studien mit experimentellem Aufbau und strenger Probandenwahl weisen häufig eine hohe interne Validität auf. Leider lassen sich ihre Ergebnisse nicht immer auf alle anderen Patienten übertragen. Die externe Validität ist also nicht gegeben.

Stichproben für die statistische Analyse

Damit sind wir auch schon beim nächsten Thema. Für die wenigsten Analysen liegen Vollerhebungen als Datengrundlage vor. Diese sind meist sehr aufwändig. Stell Dir vor, Du müsstest sämtliche Jugendlichen zwischen 13 und 17 Jahren befragen!

Daher arbeitet man fast immer mit Stichproben. Idealerweise kannst Du mit ihrer Hilfe Rückschlüsse auf die Grundgesamtheit ziehen (s. externe Validität). Damit das funktioniert, muss Deine Stichprobe eine gewisse Qualität aufweisen. Natürlich bietet sich auch die Option, einen Datenanalyse Service zu beanspruchen.

Üblicherweise ist mit „Stichprobe“ die Zufallsstichprobe gemeint, die das Ziehen einzelner Probanden aus der Grundgesamtheit beschreibt. Dabei sollte für jeden Probanden dieselbe Auswahlwahrscheinlichkeit gelten (vgl. Fahrmeir et al, 2012).

Auch hier gibt es verschiedene Ansätze. Neben der einfachen Zufallsstichprobe, in der eine gewisse Zahl an Probanden aus der Grundgesamtheit gezogen wird, existieren geschichtete Stichproben. Dabei werden Probanden erst nach Merkmalen geschichtet, anschließend wird aus jeder Schicht gezogen. Bei SPSS Clusteranaylsen werden oft bereits zuvor existierende Gruppierungen, zum Beispiel Schulklassen oder Ortschaften im Gesamten befragt.

Welche Stichprobenart gewählt wird und wie groß diese ausfällt, hängt meist von der Fragestellung ab, aber auch von zeitlichen und finanziellen Beschränkungen.

Statistische Analyse und Kausalität

Statistische Daten müssen nach dem Erheben natürlich auch analysiert werden.. Vielleicht wirst Du Deine Daten gelegentlich explorativ erkunden, also nach Mustern suchen, die Du zuvor nicht auf dem Schirm hattest. Häufiger wirst Du jedoch einer konkreten Fragestellung nachgehen. Dann ist das Ziel für die statistische Analyse, Deine Hypothesen näher zu untersuchen.

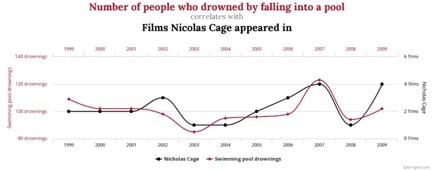

Natürlich freut man sich, wenn sich die eigenen Vermutungen (scheinbar) bestätigen. Gerade deshalb musst Du besonders aufpassen, nicht in die nächste Falle zu tappen und Kausalität mit beispielsweise einer SPSS Korrelation zu vertauschen. Dann würdest Du Zusammenhänge zwischen Variablen entdecken, die eigentlich nicht (direkt) zusammenhängen. Betrachtet man zum Beispiel Schuhgröße und Bruttoverdienst von Angestellten, zeigt sich, dass diese positiv korrelieren. Verdient man also mehr, wenn man große Füße hat? Wachsen die Füße zusammen mit dem Sparbuch? Natürlich nicht. In diesem Fall gibt es eine gemeinsame Komponente, die beide Variablen beeinflusst: Das Geschlecht. Frauen haben in der Regel kleinere Füße und verdienen weniger. Manchmal, wie in Abbildung 1, sind Zusammenhänge aber auch schlicht zufällig. Ganz egal, wie schön sie aussehen.

Abbildung 1: Zufällige Korrelation für eine statistische Analyse, Quelle: http://www.tylervigen.com/spurious-correlations

Grafische Darstellungen für die statistische Analyse

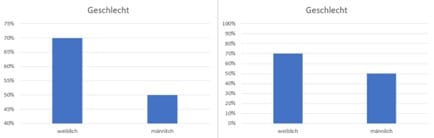

Grafische Darstellungen sind eine der häufigsten Quellen für Fehlinterpretationen. Sie können bewusst manipulierend eingesetzt werden, entstehen manchmal aber auch aus Unachtsamkeit. Sieh Dir beispielsweise Abbildung 2 an.

Abbildung 2: Barplot Geschlechterverhältnis für eine statistische Analyse, Quelle: Eigene Darstellung

Beide Grafiken zeigen die Geschlechterverteilung zwischen männlichen und weiblichen Teilnehmern. Tatsächlich zeigen beide Grafiken dieselbe Verteilung. Der scheinbare Unterschied entsteht durch eine Manipulation der y-Achse. Wie man diese Herausforderung bewerkstelligen kann, lässt sich in einer Statistik Nachhilfe ergründen.

Das Abschneiden, Weglassen oder mangelnde Beschriften der Achsen ist eine der beliebtesten Fehlerquellen bei Grafiken.

Achte aber auch darauf, Grafiken auszuwählen, die für das menschliche Auge gut erkennbar sind. Beispielsweise bekommen wir schnell Probleme, wenn sich die Winkel eines Kreisdiagramms stark ähneln. Auch 3D-Grafiken machen uns Schwierigkeiten, besonders, wenn das Volumen eine Rolle spielt. Auf der Seite der Johannes-Kepler-Universität finden sich eine Menge weitere Beispiele für missglückte Grafiken.

Statistische Analyse ist mehr als die Anwendung der korrekten Methoden. Bereits bei der Datengewinnung musst Du sorgfältig vorgehen, damit Deine Ergebnisse aussagekräftig sind. Auch die Darstellung dieser Ergebnisse sollte gut durchdacht sein, um nicht versehentlich Aussagen zu treffen, die so nie vorgesehen waren. Statistische Ergebnisse zu formulieren, die ihren Ursprung aus einer fundierten Analyse nehmen, ist demzufolge das zu erreichende Ziel. Beachtest Du die Hinweise in diesem Artikel, kannst Du die üblichen Fallstricke vermeiden.

Literatur

Fahrmeir, Ludwig/Heumann, Christian/Künstler, Rita/Pigeot, Iris/Tutz, Gerhard (2012): Statistik: Der Weg zur Datenanalyse, 7. Auflage Berlin.

Diekmann, Andreas (2007): Empirische Sozialforschung: Grundlagen, Methoden, Anwendungen, 4. Auflage Reinbeck/Berlin.